2024年10月15日至17日,开放计算全球峰会(OCP Global Summit)在美国加州圣何塞(San Jose)举行。峰会以“从创新到影响力(From Ideas to Impact)”为主题,聚焦AI基础设施建设,吸引了全球7000余名专业人士参与。在此盛会上,阿里云磐久AI Infra 2.0服务器携手UALink联盟,展示了AI互连技术的最新进展。

阿里云服务器研发资深总监文芳志与UALink联盟主席Kurtis Bowman联合发表演讲《UALink: Pioneering the AI Accelerator Revolution》,深入讨论了AI服务器Scale UP互连技术、UALink标准的发展蓝图,以及UALink联盟与ALink System产业生态的合作前景。此次合作标志着AI服务器互连技术的新纪元。

UALink协议由行业领先的AI芯片、服务器和CSP厂商联合发起,旨在改变AI服务器Scale UP互连技术生态。与UEC协议不同,UALink支持高性能内存语义访问、显存共享,并具备超高带宽和超低时延等优势,构建起一个开放的AI服务器Scale UP互连技术生态。UALink联盟计划于10月底正式成立,并在年底发布第一版UALink spec。

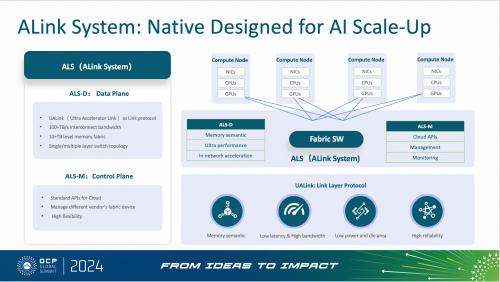

面对中国市场的挑战,ALink System(ALS)产业生态应运而生,提供具备性能竞争力和统一标准的互连系统。ALS包括ALS-D数据面和ALS-M管控面,为AI训练和推理场景提供支持。ALS-D支持UALink国际标准,形成性能竞争力的数据面方案,具备并行切分算法、大显存共享等特点。ALS-M则为不同芯片方案提供标准化接入方案,支持开放生态和厂商专有互连协议的统一软件接口。

遵循ALink System规范,阿里云自主设计了磐久AI Infra 2.0服务器,体现了开放生态、高能效、高性能和高可用的设计理念。该服务器定义了AI计算节点和Scale Up/Scale Out互连系统,支持业界主流AI方案,推动AI领域的“一云多芯”发展。

ALink System全面兼容UALink生态,与行业伙伴共建超高性能、超大规模的Scale UP集群互连能力。一级互连支持64-80个节点,二级互连可达2000个以上节点,提供PB级共享显存和TB级互连带宽。

磐久AI Infra 2.0服务器集成了阿里自研CIPU 3.0芯片,支持高带宽大规模AI服务器实现Scale Out网络扩展,同时满足云网络弹性、安全的要求。在硬件工程方面,服务器单机柜支持最大80个AI计算节点,采用400V PSU,单体供电效率可达98%,整体供电效率提高2%。散热设计上,机柜级液冷方案根据实际负载动态调整CDU冷却能力,降低能耗,单柜冷却系统节能30%。运维管理上,全新的CableCartridge后维护设计,支持全盲插,零理线易运维、零误操作,维护效率提升50%。

在可靠性方面,磐久AI Infra 2.0服务器支持弹性节点、智能路由、高可靠供电、分布式CDU等技术,实时监控、探测各种硬件故障并自愈,硬件的故障域缩减到节点级。

阿里云秉持开放合作策略,在ALink System产业生态建设上推动互连技术领域的发展和繁荣。自ALink System产业生态发布以来,已有20多家AI芯片、互连芯片、服务器整机硬件和IP设计厂商加入,成员单位就相关协议标准制定和实行路径选择展开交流。

阿里云不仅是UALink的积极支持者和ALink System产业生态的牵头者,还是OCP、CXL、UCIe和UEC等多个互连技术行业组织的创始成员或技术委员会成员,通过实际行动支持开放互连技术标准的制定和落地。

在本届OCP峰会上,阿里云磐久AI Infra 2.0服务器的展示,不仅证明了其在AI基础设施领域的技术实力和创新能力,也体现了阿里云在推动开放计算和AI技术发展中的领导地位。随着技术的不断进步和合作的深入,我们有理由相信,阿里云将继续引领AI技术的未来发展,为全球客户提供更加强大、灵活和高效的AI基础设施解决方案。

未经数字化报网授权,严禁转载或镜像,违者必究。

特别提醒:如内容、图片、视频出现侵权问题,请发送邮箱:tousu_ts@sina.com。

风险提示:数字化报网呈现的所有信息仅作为学习分享,不构成投资建议,一切投资操作信息不能作为投资依据。本网站所报道的文章资料、图片、数据等信息来源于互联网,仅供参考使用,相关侵权责任由信息来源第三方承担。

Copyright © 2013-2023 数字化报(数字化报商业报告)

数字化报并非新闻媒体,不提供新闻信息服务,提供商业信息服务

浙ICP备2023000407号数字化报网(杭州)信息科技有限公司 版权所有